【哪吒开发板试用】基于哪吒开发套件实现人体姿态检测

前言

随着人工智能技术的快速发展,人体姿态检测已经成为计算机视觉领域中一个重要的研究方向。本教程将介绍如何使用哪吒开发板和 MediaPipe 框架来实现实时人体姿态检测。

哪吒开发板凭借其强大的 Intel 处理器和优秀的 GPU 性能,非常适合进行各类 AI 应用的开发和部署。通过本教程,您将学习到:

- 哪吒开发板的基本特性和优势

- Ubuntu 系统的安装和配置

- MediaPipe 框架的使用方法

- 实时人体姿态检测的具体实现

本教程适合对 AI 应用开发感兴趣的开发者,无论您是初学者还是有经验的开发人员,都能从中获得有价值的参考。让我们开始动手实践,探索人体姿态检测的精彩世界吧!

一、哪吒开发板简介

哪吒开发板是一款高性能、多功能的计算平台,以下是其简介:

1. **核心处理器**:哪吒开发板采用英特尔®处理器 N97(Alder Lake-N),支持四核 SoC,时钟频率高达 3.60GHz,TDP 仅为 12W。

2. **图形处理**:内置 Intel® UHD Graphics Gen12,最多 24 个执行单元,支持包括 INT8 在内的主要数据类型,通过 HDMI 1.4b 端口支持 30Hz 的 4K UHD(3840×2160)高分辨率显示。

3. **内存与存储**:哪吒开发板支持高达 8GB 的 LPDDR5 系统内存和高达 64GB 的 eMMC 存储。

4. **安全性**:板载 TPM 2.0,提供硬件级别的安全支持。

5. **接口与扩展性**:配备 40 针 GPIO 连接器,可配置为 PWM、UART、I2C、I2S、SPI 和 ADC,为开发者提供构建解决方案的灵活性。

6. **操作系统支持**:支持 Windows 和 Linux 操作系统,使其适用于多种应用场景。

7. **散热设计**:采用无风扇冷却器,适用于需要低噪音或无噪音环境的应用。

8. **应用领域**:哪吒开发板适用于教育、物联网网关、数字标牌和机器人等多种应用。

哪吒开发板以其强大的性能、丰富的接口和灵活的扩展性,为开发者提供了一个高效的开发平台,适用于多种边缘计算和智能应用的开发和部署。

二、安装 Ubuntu 系统

1. 准备工作

- 下载 Ubuntu 20.04 系统镜像(从官方网站下载)

- 准备一个 USB 启动盘(建议 8GB 以上)

- 准备 USB 键盘鼠标和 HDMI 显示器

2. 系统安装

```bash

# 使用 USB 启动盘进行系统烧录

# 1. 按照工具提示完成烧录过程

# 2. 烧录完成后重启设备

```

3. 首次启动设置

- 连接显示器、键盘和鼠标

- 接通电源,等待系统启动

- 按照向导完成初始化设置(用户名、密码等)

- 配置网络连接(可选择有线或无线网络)

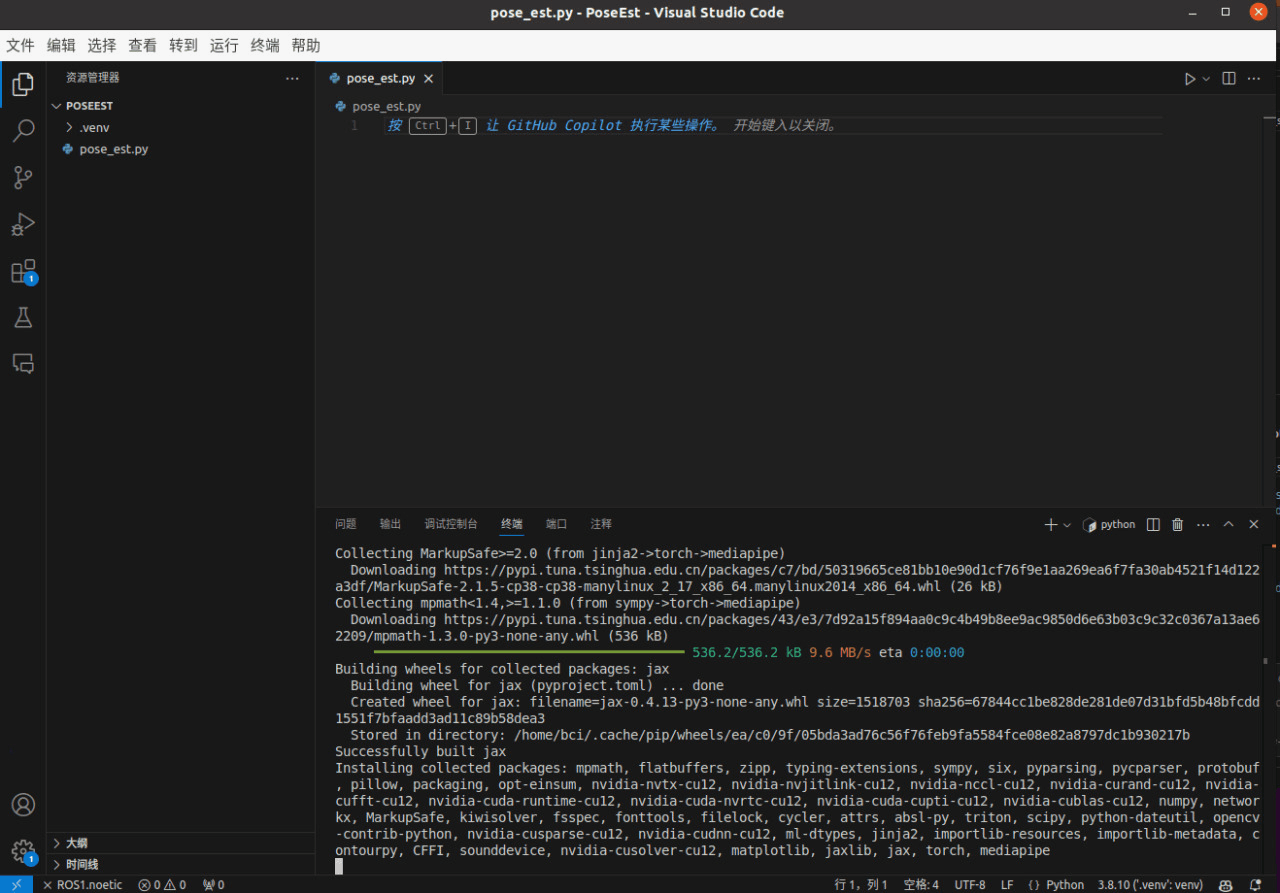

三、部署姿态检测模型

1. 环境配置

```bash

# 安装 Python 和必要的包管理工具

sudo apt install python3-pip

# 安装依赖库

pip3 install mediapipe

pip3 install opencv-python

pip3 install numpy

```

2. MediaPipe 介绍

MediaPipe 是 Google 开源的机器学习解决方案工具包,提供了多个现成的人工智能模型,包括人体姿态检测、人脸检测、手势识别等。本教程使用 MediaPipe 的姿态检测模型,它可以识别人体的 33 个关键点。

3. 实现代码

```python

import cv2

import mediapipe as mp

# 初始化MediaPipe姿态检测

mp_pose = mp.solutions.pose

mp_drawing = mp.solutions.drawing_utils

pose = mp_pose.Pose(

min_detection_confidence=0.5,

min_tracking_confidence=0.5)

# 打开摄像头

cap = cv2.VideoCapture(0)

while cap.isOpened():

# 读取视频帧

success, image = cap.read()

if not success:

print("无法读取摄像头画面")

continue

# 转换为RGB格式供MediaPipe处理

image = cv2.cvtColor(image, cv2.COLOR_BGR2RGB)

image.flags.writeable = False

# 进行姿态检测

results = pose.process(image)

# 转回BGR格式用于显示

image.flags.writeable = True

image = cv2.cvtColor(image, cv2.COLOR_RGB2BGR)

# 绘制姿态关键点和连接线

if results.pose_landmarks:

mp_drawing.draw_landmarks(

image,

results.pose_landmarks,

mp_pose.POSE_CONNECTIONS)

# 显示结果

cv2.imshow('MediaPipe Pose', image)

# 按'q'退出

if cv2.waitKey(5) & 0xFF == ord('q'):

break

# 释放资源

cap.release()

cv2.destroyAllWindows()

pose.close()

```

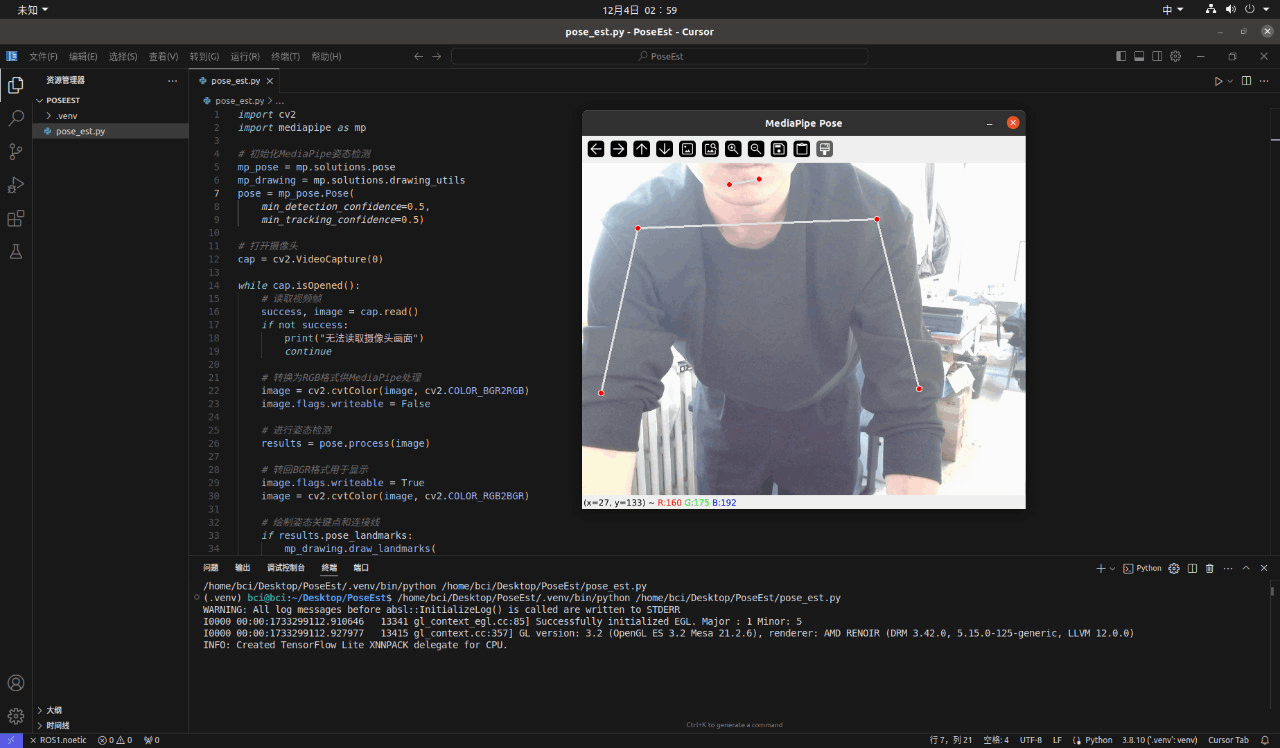

4. 运行效果

- 程序启动后会打开摄像头

- 实时检测画面中的人体姿态

- 在画面中绘制骨架关键点和连接线

- 按 'q' 键可以退出程序

5. 关键点说明

MediaPipe Pose 可以检测以下关键点:

- 面部关键点:鼻子、眼睛、耳朵等

- 上半身关键点:肩膀、手肘、手腕等

- 下半身关键点:臀部、膝盖、脚踝等

- 手部关键点:手掌、手指等

6. 性能优化建议

- 调整检测置信度阈值

- 根据实际需求选择合适的图像分辨率

- 可以考虑使用 GPU 加速(需要额外配置)

7. 常见问题解决

- 如果摄像头无法打开,检查设备权限

- 如果运行速度较慢,可以降低图像分辨率

- 如果检测不准确,可以调整光线条件

四、总结

本教程介绍了如何在哪吒开发板上使用 MediaPipe 实现人体姿态检测。通过简单的 Python 代码,我们实现了实时的人体姿态检测功能。这个项目可以作为更复杂应用的基础,比如运动姿势分析、动作游戏控制等。

希望这个教程能帮助你快速入门人体姿态检测的开发。如果遇到问题,欢迎在评论区讨论交流。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)